- O número de políticas de inteligência artificial (IA) cresceu 30% desde 2022, totalizando mais de 1.300 regulamentações no mundo, segundo a Organização para a Cooperação e Desenvolvimento Econômico (OCDE).

- A expansão é impulsionada pela necessidade de controlar riscos associados à tecnologia, especialmente após o lançamento do ChatGPT.

- Há divergências entre potências como Estados Unidos, União Europeia e China, que adotam agendas próprias.

- No Brasil, a Estratégia Brasileira de Inteligência Artificial, lançada em 2021, enfrenta dificuldades na implementação, e tramita no Congresso o Projeto de Lei 2338/23 para criar um marco legal.

- A falta de alinhamento internacional pode aumentar o risco de uso indevido da IA, com um aumento de 60% nos incidentes graves registrados pela Universidade de Stanford em 2024.

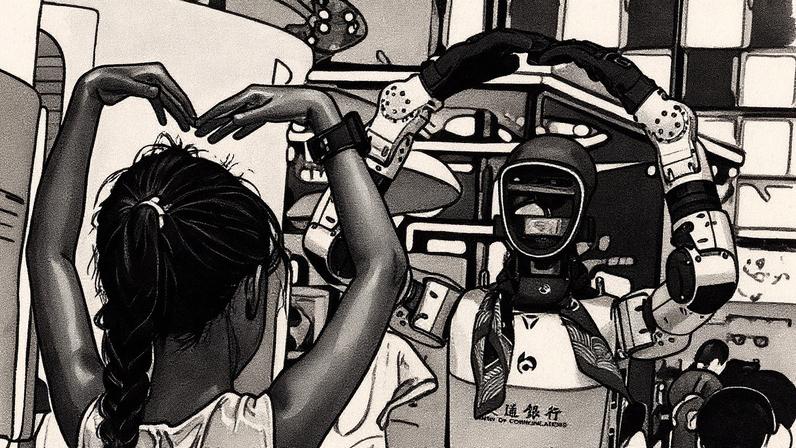

O número de políticas de inteligência artificial (IA) cresceu 30% desde 2022, totalizando mais de 1.300 regulamentações em todo o mundo, conforme dados da OCDE. Essa expansão é impulsionada pela necessidade de controlar os riscos associados à tecnologia, especialmente após o lançamento do ChatGPT. No entanto, a falta de consenso internacional é evidente, com potências como Estados Unidos, União Europeia e China adotando agendas próprias.

Enquanto os países desenvolvidos avançam, o Sul Global enfrenta desafios significativos. Apenas um terço das nações em desenvolvimento possui estratégias nacionais de IA, em contraste com dois terços das economias avançadas. A ONU aponta que 118 países ainda não participam de discussões sobre a governança da IA. No Brasil, a Estratégia Brasileira de Inteligência Artificial, lançada em 2021, enfrenta dificuldades na implementação. Atualmente, tramita no Congresso o Projeto de Lei 2338/23, que visa criar um marco legal inspirado nas diretrizes da União Europeia.

Divergências nas Políticas de IA

O G7 e a União Europeia concentram cerca de 30% das políticas existentes, incluindo subsídios para infraestrutura e exigências de mitigação de riscos. A nova Lei de IA da UE, que entrará em vigor em agosto de 2026, prevê avaliações obrigatórias de risco e multas para infratores. Nos EUA, a política de IA sofreu mudanças significativas com a administração Trump, que revogou diretrizes anteriores e lançou um plano para exportar tecnologia americana.

A China, por sua vez, bloqueou serviços estrangeiros como o ChatGPT, investindo em semicondutores e modelos locais. Apesar de alguns esforços multilaterais, como a proposta de monitoramento de riscos do G7, as divergências persistem. Em fevereiro, EUA e Reino Unido não assinaram uma declaração de Paris sobre desenvolvimento inclusivo da IA, apoiada por 60 países.

Aumento de Incidentes Relacionados à IA

Analistas alertam que a falta de alinhamento internacional pode aumentar o risco de uso indevido da IA, especialmente em armas letais e ciberataques. A Universidade de Stanford registrou 230 incidentes graves em 2024, um aumento de 60% em relação ao ano anterior. Casos associados ao ChatGPT foram até vinculados a suicídios. No setor privado, apenas 39% das empresas possuem comitês de governança, segundo a Associação Internacional de Profissionais de Privacidade.

Embora líderes como a OpenAI tenham solicitado cooperação internacional, a competição entre países e empresas parece prevalecer sobre a busca por regras globais.